Можно ли различить человеческий креатив и нейроконтент: творчество брендов под угрозой

И люди, и ИИ-детекторы ошибаются.

Социальные сети кишат ИИ-контентом — от брейнрот-видео с беременными котами до невероятно реалистичных ИИ-блогеров, рекламирующих бренды. При этом растёт тревога людей по поводу применения искусственного интеллекта. По данным Brand Analytics, почти треть (28%) обсуждений ИИ ведётся в негативном ключе. Люди боятся фейков, дезинформации и обесценивания человеческого труда.

Коллективное недовольство ИИ уже можно заметить в мемах, комментариях в духе «Лайк, если это ИИ» и войнах между блогерами и авторами, которых подозревают в использовании нейросетей. Очевидно, что стирание границы между человеческим и машинным творчеством нравится не всем.

Мемы и комментарии в Instagram*, осуждающие ИИ-контент

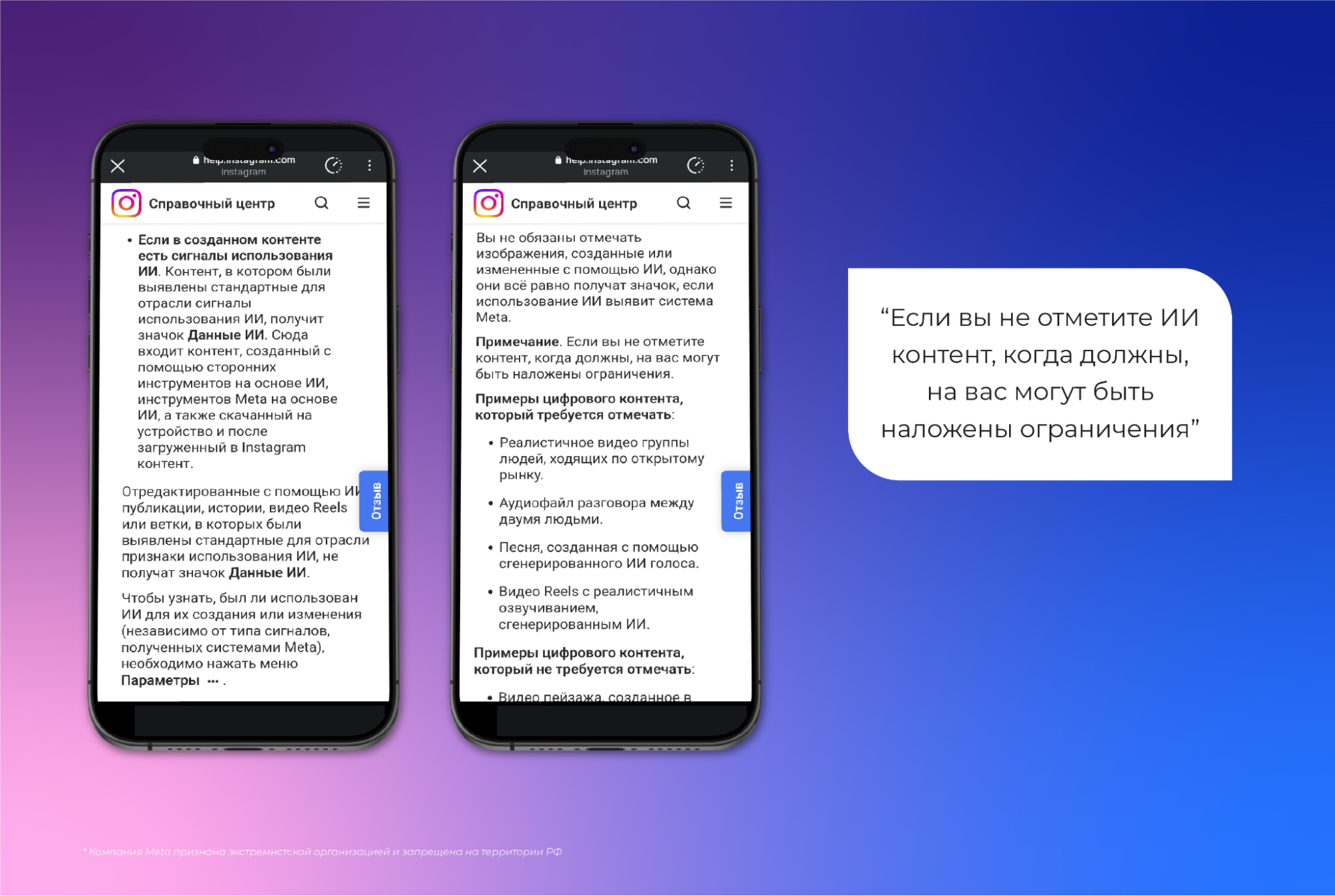

Социальные сети замечают проблему и принимают меры. Так, Instagram* автоматически помечает некоторые публикации маркировкой «Данные ИИ».

Политика Instagram* в отношении маркировки ИИ-контента

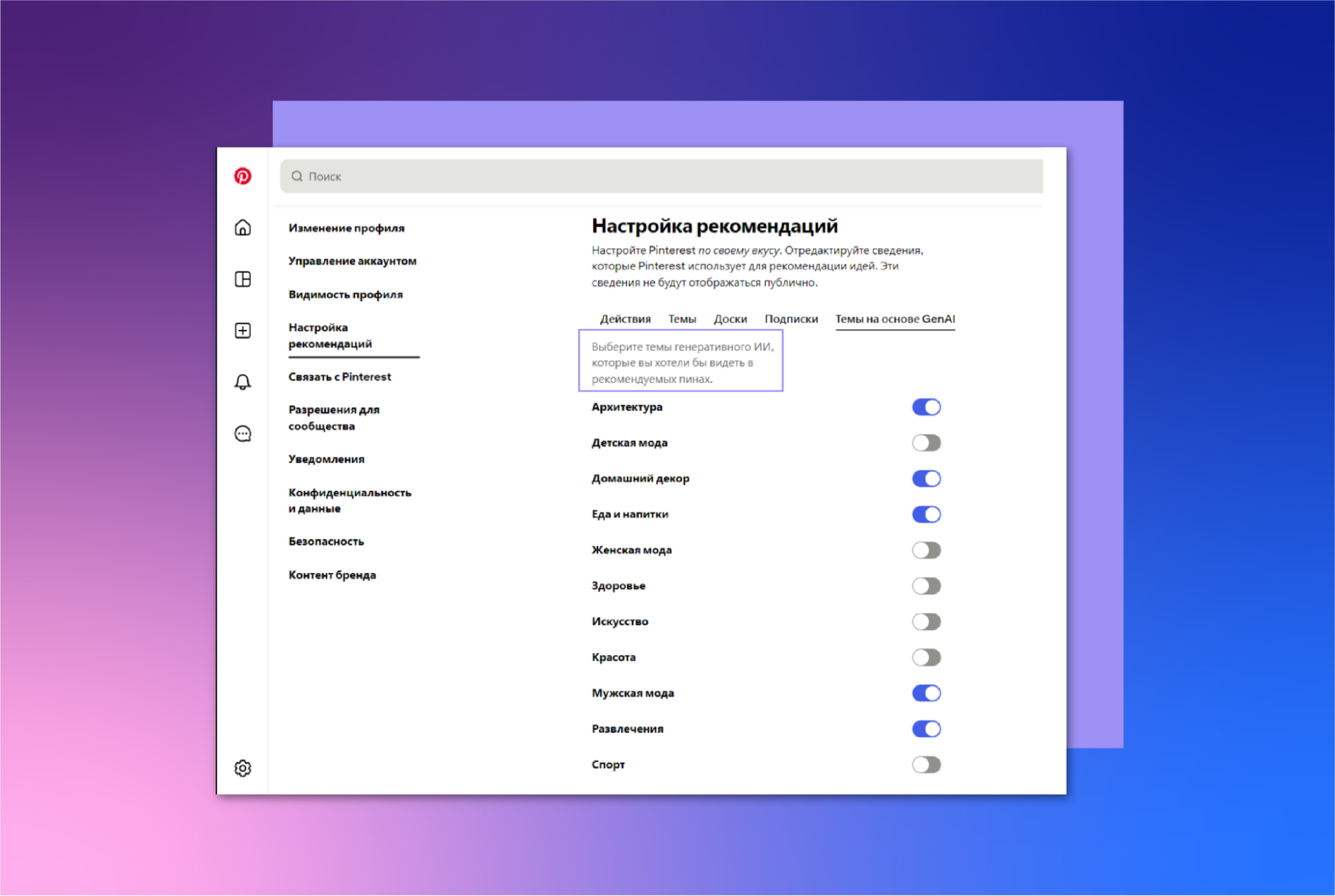

Pinterest позволяет настроить рекомендации так, чтобы вам не попадался сгенерированный контент, а YouTube пошёл ещё дальше и теперь удаляет ИИ-контент со своей платформы.

Настройки рекомендаций в Pinterest

Но модерация — палка о двух концах. С одной стороны, она защищает от фейков и низкокачественного контента. С другой — непонятно, по каким критериям определяется качественность контента и искусственность его происхождения. Как именно алгоритмы отличают ИИ-контент от человеческого? Насколько им можно доверять? И что будет, если ваш собственный уникальный контент, в который вложены время, идеи и труд, алгоритм ошибочно примет за продукт нейросетей?

Кейс Ufesa: реальные фото среди ИИ-контента

Это не гипотетический риск. С этим мы, креативное агентство Fusion, столкнулись на практике, работая над SMM-стратегией и созданием контента для социальных сетей Ufesa — известного испанского бренда бытовой техники.

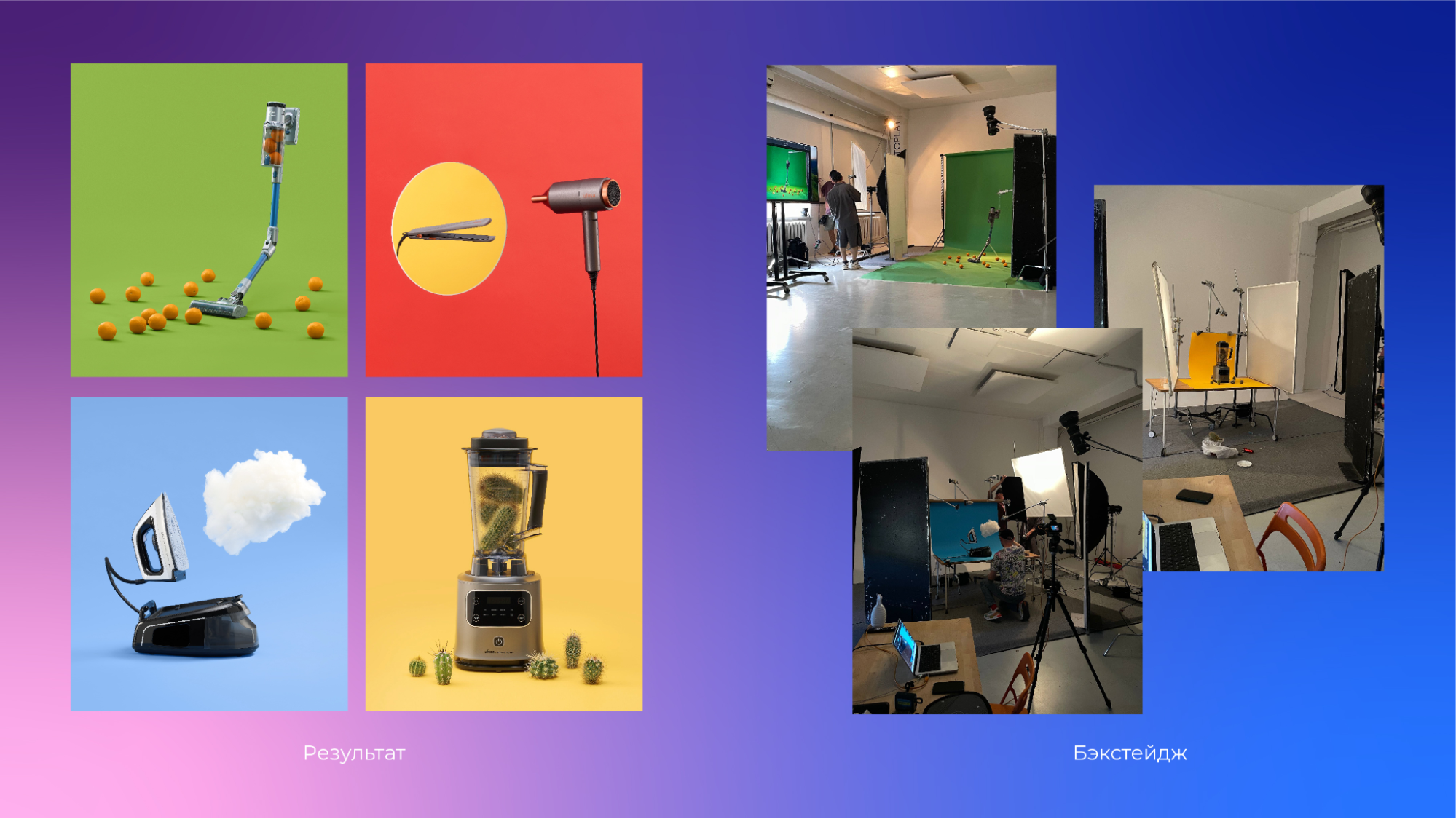

Наша задача была в том, чтобы создать для соцсетей бренда контент, который будет выделяться на фоне стандартных рекламных фото. Мы черпали вдохновение в работах великих испанских художников Сальвадора Дали и Пабло Пикассо. Результатом стала концепция «Бытовой абсурд», которая воплотилась в серии фотографий. Бытовая техника стала центральным элементом необычных сцен, в которых она взаимодействует с неожиданными предметами.

Съёмки для соцсетей Ufesa

Клиент: ООО «Эталон-Импорт», официальный дистрибьютор Ufesa в России

Агентство: Агентство FUSION. Ирина Моисеева, Виктория Алексеева, Ксения Сиденко, Анна Микуленко

Продакшен: Дмитрий Дашков, Алия Самохина

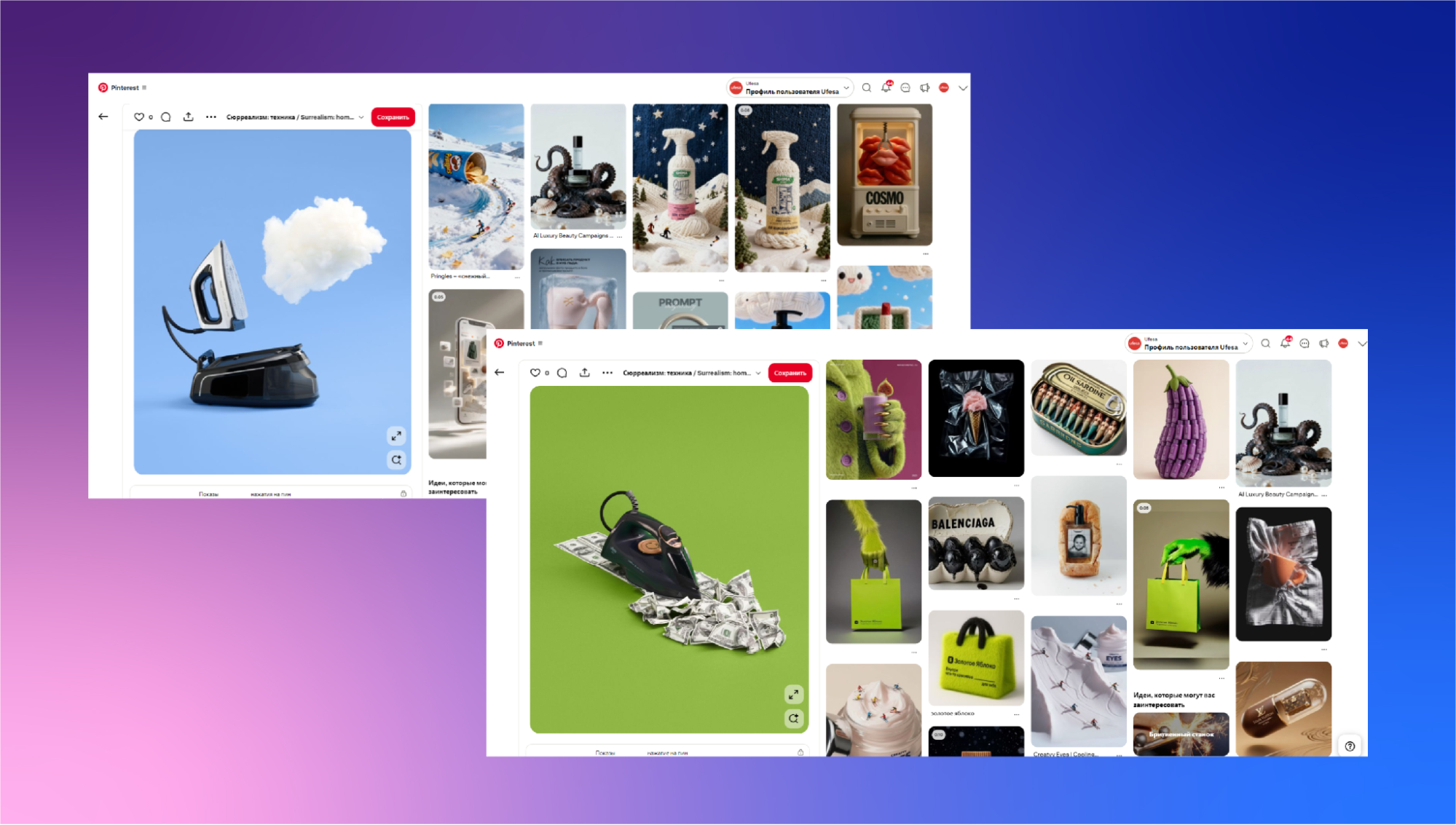

В какой-то момент мы обнаружили, что наши реальные, профессионально отснятые фотографии, алгоритмы Pinterest начали объединять в рекомендациях со сгенерированными изображениями. Мы задумались о том, могут ли современные алгоритмы видеть разницу между изображениями, созданными человеком и сгенерированными нейросетью. Поэтому решили проверить сервисы, которые выявляют ИИ-контент. К сожалению, мы не можем заглянуть внутрь алгоритмов Meta*, Pinterest или YouTube, но можем протестировать публичные ИИ-детекторы, которыми потенциально пользуется наша аудитория, чтобы выяснить способны ли они отличить человеческое творчество от ИИ, особенно когда это творчество выглядит сюрреалистично.

Рекомендации Pinterest и фото для Ufesa

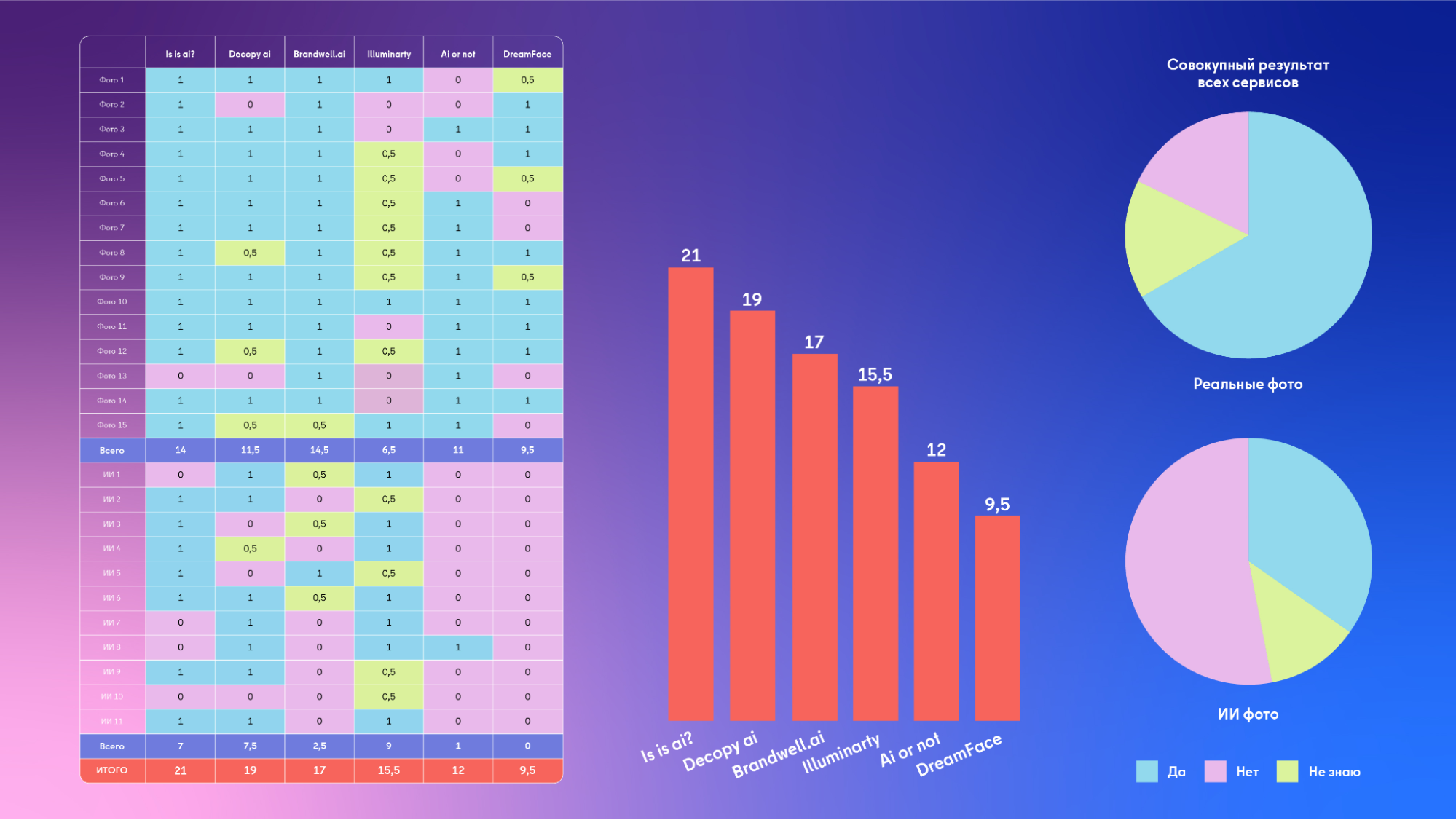

Рейтинг ИИ-детекторов: кто что распознал

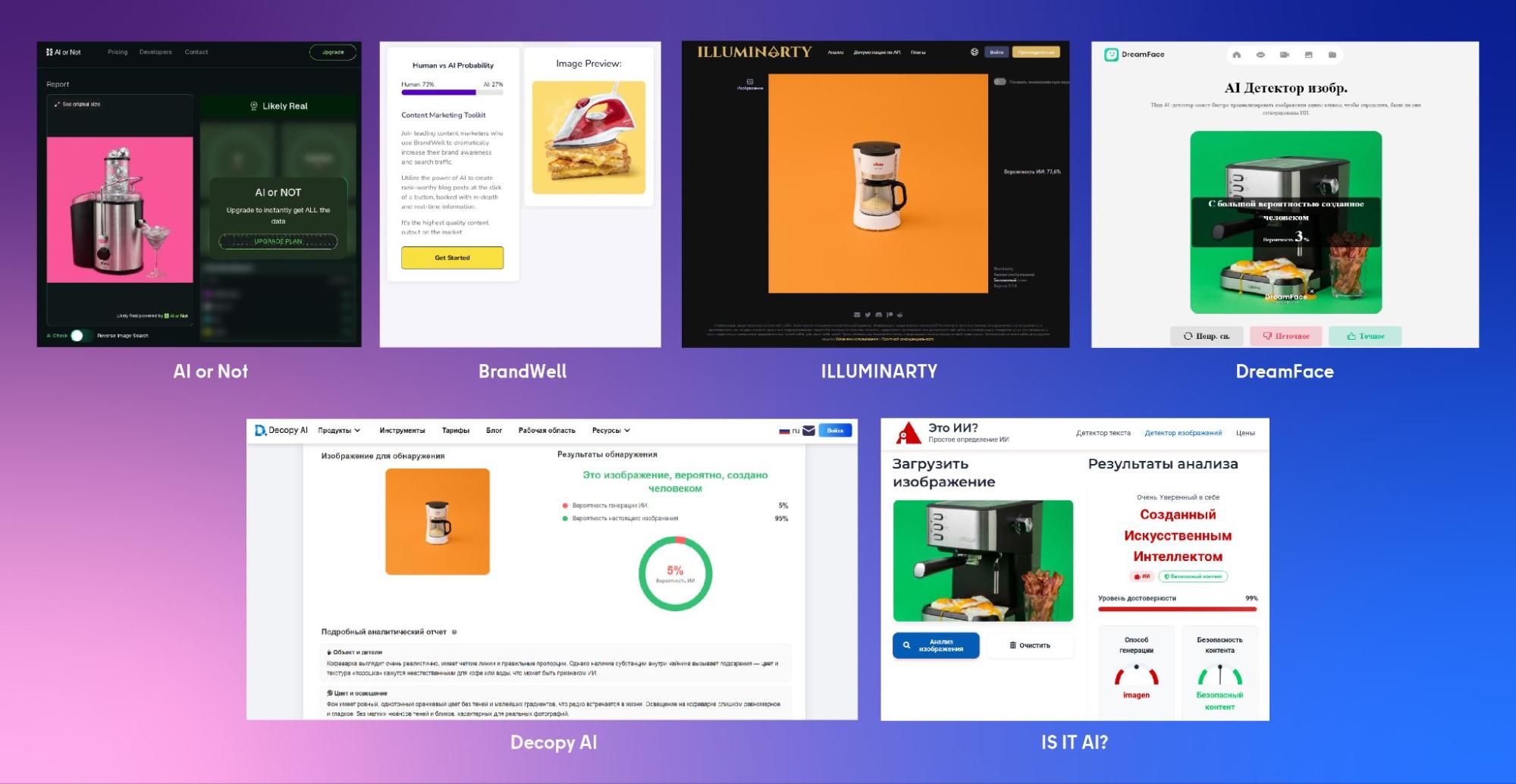

Мы протестировали шесть популярных сервисов определения ИИ на изображениях: . Выбирали детекторы по принципу наибольшей частоты упоминаний в статьях разных профильных медиа и блогов. Нам было важно проверить сервисы, которые на слуху у большинства пользователей.

Чтобы оценить практическую эффективность этих инструментов, мы подготовили два набора изображений:

-

Человеческий контент (15 фото). Реальные фотографии в стиле сюрреализм, отснятые профессиональной командой.

-

ИИ-контент (11 фото). Изображения, сгенерированные нейросетью в похожем стиле или в точности повторяющие сюжет реальных фотографий.

Каждое из 26 изображений было последовательно загружено в шесть выбранных сервисов-детекторов. Мы фиксировали два ключевых параметра: вердикт системы («человек»/«ИИ») и степень уверенности (процентная вероятность, которую указывает сервис).

Критерии оценки (начисление баллов):

-

1 балл. Сервис дал правильный вердикт, и его степень уверенности была 70% и выше.

-

0 баллов. Сервис дал неправильный вердикт ИЛИ его степень уверенности в правильном ответе была ниже 30%.

-

0,5 баллов. Вердикт сервиса был правильным, но степень уверенности составляла 31%-69%.

Таким образом, максимальное количество баллов — 26.

По результатам тестирования у нас получился следующий рейтинг:

Результаты тестирования и рейтинг ИИ-детекторов

Несмотря на то, что 4 из 6 сервисов набрали больше 50% баллов, по-настоящему справились с заданием только Decopy ai и Is it ai. Они давали верный вердикт в большинстве случаев для обоих типов контента: и для реальных фото, и для сгенерированных изображений. Хотя результат всё ещё далёк от идеала.

Ai or not, DreamFace, Brandwell.ai чаще всего правильно определяли контент, созданный человеком, но при этом почти все сгенерированные изображении им тоже казались реальными. Так., Ai or not и Brandwell.ai зарабтали по 1 и 1,5 балла соответственно в части определения сгенерированных изображений. А Dreamface счёл за созданный человеком вообще весь ИИ-контент и получил заслуженные 0 баллов. Фактически эти сервисы не справляются со своей главной задачей — обнаруживать следы ИИ на изображениях.

Illuminarty же наоборот правильно определил все сгенерированные картинки как ИИ, хотя иногда степень его уверенности в ответе были ниже референтного значения. Можно подумать — вот он, наш чемпион. Но не тут-то было. Все реальные фото он тоже клеймил как ИИ. Программа как будто решила подстраховаться и на всякий случай сказать, что все фото созданы нейросетью.

Итак, результаты теста показали, насколько ИИ-детекторы несовершенны. Лишь два сервиса (Decopy.ai и Is it AI) показали себя более-менее достойно, корректно определив больше половины и реальных, и сгенерированных изображений. Остальные же выдали системные сбои: Ai or not, Dreamface, Brandwell.ai приняли почти все ИИ-изображения за работу человека, а Illuminarty наоборот пометил абсолютно весь контент как ИИ.

ИИ-детекторы в действии (примеры)

Вывод: сюрреализм и художественные приёмы сбивают с толку алгоритмы, а это в теории значит, что креативный контент брендов оказывается под угрозой ложной автоматической цензуры.

Это не ИИ! Но поверят ли нам люди?

Для нас такие результаты стали тревожным звонком: если даже алгоритмы не видят разницы, видит ли ее человек?

Данные ВЦИОМ подтверждают наши опасения: люди далеко не всегда способны отличить контент, созданный ИИ, от реального — лишь в 6 из 10 случаев. Значит ли это, что подписчики Ufesa тоже могли посчитать нашу креативную работу просто удачным промптом? Этот вопрос заставил задуматься о более широкой проблеме: как использование ИИ-контента брендами влияет на доверие и вовлечённость их аудитории? Чтобы найти ответ, мы планируем большое исследование. Обязательно поделимся результатами в будущем!

Что сейчас делать брендам? Пока универсального решения нет, но путь к сохранению доверия аудитории нам видится в прозрачности. Иногда лучше честно признаться в использовании нейросетей, чем делать вид, что всё сделано вручную. Например, сгенерированный контент можно помечать подписью «Создано с помощью ИИ». А чтобы подчёркнуть человеческое авторство и уникальность контента, можно поделиться «закулисьем» процесса его создания: эскизами или фото и видео со съёмок.

*Соцсети Instagram и Facebook запрещены в РФ; они принадлежат корпорации Meta, которая признана в РФ экстремистской.

Мнение редакции может не совпадать с мнением автора. Ваши статьи присылайте нам на 42@cossa.ru. А наши требования к ним — вот тут.