Верификация информации: как не попасться на удочку deepfake

Проводим расследование и определяем фейки самостоятельно.

Фейковая информация повсюду. По данным АНО «Диалог Регионы», количество фейков за последние 3 года увеличилось в 10 раз. Число недостоверных сообщений в 2023 году в России выросло до 11 млн (1,5 млн в 2021 году). Наибольшее количество фейков зафиксировано в Telegram (28%), ещё 45% подобных новостей появилось в других отечественных социальных сетях. Доля fake news в СМИ увеличилась на 69% по сравнению с 2022 годом.

Ложная информация, поступающая в СМИ и социальные сети, не только формирует негативный имидж компании, но и влияет на общественное мнение. Именно поэтому важно регулярно работать над качеством контента и предоставлять аудитории только проверенные новости

Искусственный интеллект и распространение недостоверных видео

Сегодня любой пользователь с помощью стандартной программы может конкурировать с видеохостингами в производстве контента. Правда, многие такие ролики сгенерированы нейросетью или вовсе не относятся к описываемому факту. Согласно исследованию Deep Media, в 2023 году количество

Актуальным остаётся и вопрос правомерного использования подобных роликов. В декабре 2023 года компания «Рефейс Технолоджис» обратилась с иском к организации Roistat. Последняя незаконно использовала в рекламе своего мероприятия deepfake с лицом актёра Киану Ривза, созданный Agenda Media Group (партнёр «Рефейс Технолоджис»).

По итогам разбирательств российский суд впервые признал deepfake объектом авторского права и обязал Roistat выплатить компенсацию в размере 500 тысяч рублей. Согласно решению исполнительного органа власти, сгенерированное нейросетью видео — «дополнительный инструмент обработки» видео, а не способ его создания.

Три главных вопроса

Для осуществления качественной верификации необходимо провести собственное расследование. Появление фейков чаще всего обусловлено двумя проблемами: распространением устаревшего контента, который преподносится как новый в социальных сетях, и предоставлением

В основе верификации роликов лежат три вопроса.

Кто снял видео? Прежде чем выйти на связь с пользователем, опубликовавшим видео, нужно убедиться, не разместил ли подобный ролик

Когда был снят ролик? Необходимо просмотреть новости социальных сетей и почитать статьи местных СМИ для установления даты съёмки. Перекрестное сравнение видео с другим визуальным контентом в социальных сетях позволит найти дополнительные несоответствия. Такая проверка может осуществляться с использованием ключевых слов на местном, английском и других языках, которые имеют отношение к региону.

Где было снято видео? Для подтверждения геолокации можно запросить у стрингеров координаты в режиме реального времени, чтобы подтвердить их нахождение на месте событий. Более того, следует сравнить локацию на видео с публикациями в других СМИ, а также проверить здания, особенности рельефа, языки и акценты местности.

Помимо этого стоит обращать внимание на изменение соотношения сторон видео и заметное ухудшение качества ролика. Подобные явления могут быть признаком использования контента из нескольких источников. Также можно уточнить прогноз погоды, время суток и архитектуру на видео. Так удастся выявить старые кадры или снятые не совсем там, где было изначально заявлено.

Платформы, позволяющие проверить надёжность видеоконтента

Провести верификацию можно и с помощью приложений. Видеоагентство RUPTLY использует специальные платформы, позволяющие в короткие сроки определить недостоверное видео.

InVID. Сервис, помогающий проверить надёжность и точность видеоконтента, распространяемого через социальные сети. Платформа предоставляет различные инструменты для верификации видео. Например, технология Key Frames даёт возможность исследовать ролик на предмет архивных материалов. С помощью приложения можно разбить видео на кадры и проверить каждый из них.

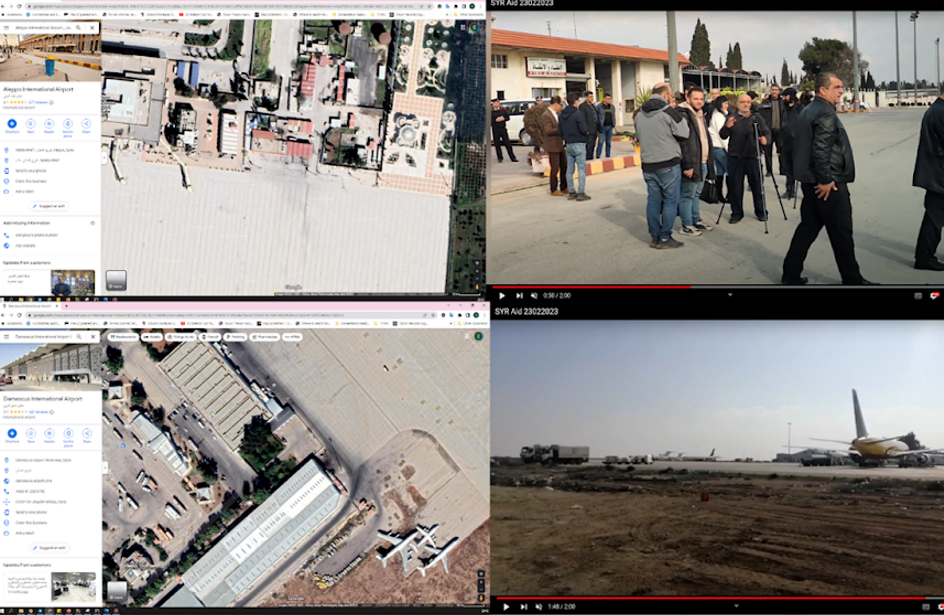

Благодаря раскадровке InVID удобно сравнивать локации на роликах. В видеоагентстве RUPTLY с помощью платформы часто определяют несоответствие места в видео и сообщениях других СМИ.

В ролике есть информация о событиях в аэропорту Алеппо (локация подтверждена в СМИ) и об аэропорте в Дамаске (не относится к новости, нет упоминаний в медиа).

RevEye. Инструмент, позволяющий осуществить обратный поиск изображений в различных поисковых системах. Сервис отлично работает в комбинации с InVID. Отдельные кадры, предоставленные приложением InVID, загружаются в RevEye. Обратный поиск изображений позволяет найти оригинал снимка, определить первоисточник и отследить, как изменялось фото.

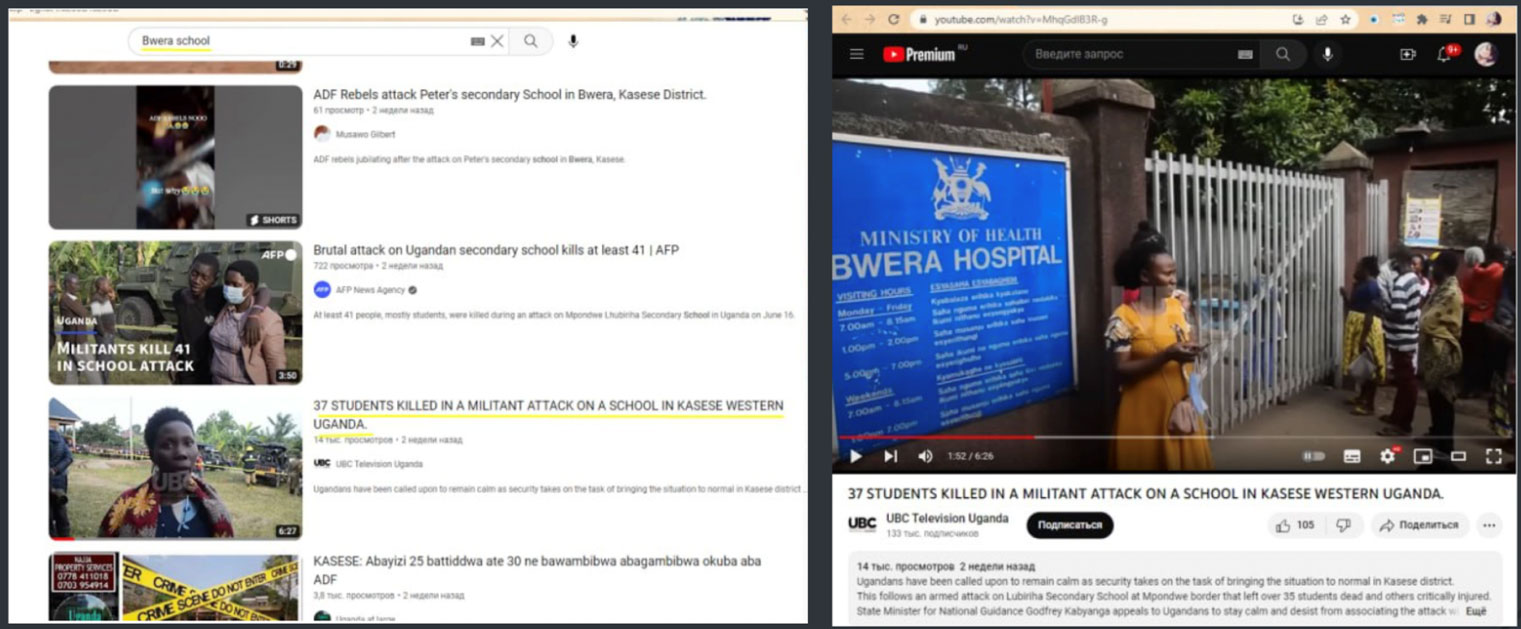

Поиск по ключевым словам. Один из популярнейших способов проверки контента. Поиск по нескольким комбинациям ключевых слов (в зависимости от инфоповода) может показать, были ли кадры опубликованы ранее в социальных сетях.

Сюжет об атаке повстанцев предлагался RUPTLY как эксклюзивный, однако часть контента, вероятно, была продана другому СМИ или же взята у него. Благодаря поиску по ключевым словам видеоагентству удалось найти такой же ролик. Если бы компания разместила видео на своем сайте, то нарушила бы авторские права.

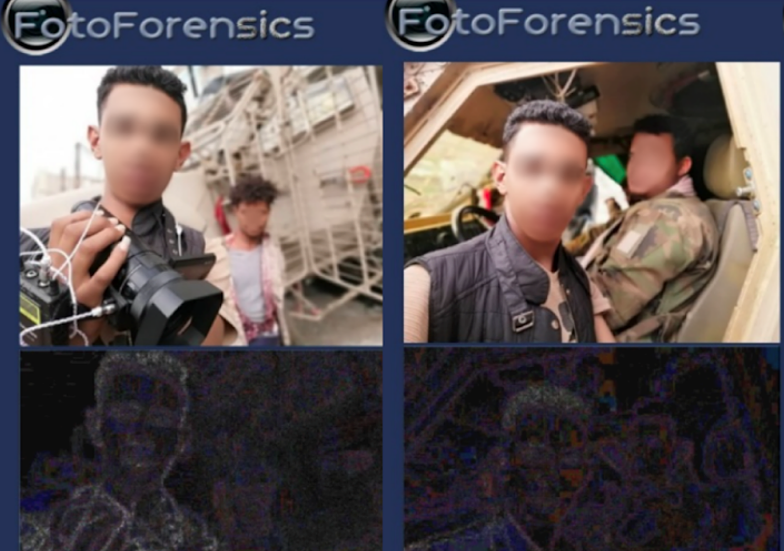

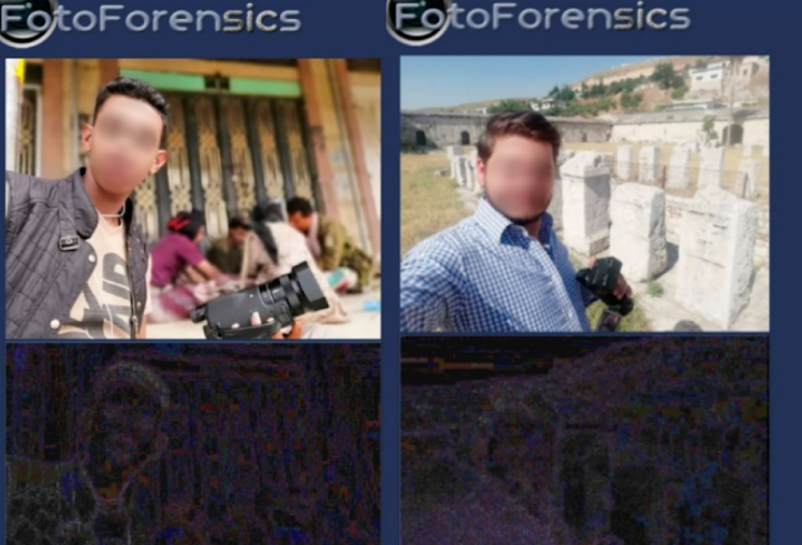

FotoForensics. Инструмент для проверки изображений, отредактированных ранее в Photoshop. Сервис поможет выделить подобные фото и даже покажет оригинал. На кадрах наглядно видно, как FotoForensics определяет первоначальные снимки.

Длительность верификации зависит от объёма и качества видео или фото, но нужно понимать, что этот процесс важен для репутации СМИ и необходим так же, как проверка любого инфоповода. Современные видеоагентства разрабатывают собственные программы, благодаря которым обнаружить deepfake станет намного проще. Подобные сервисы появятся в ближайшие несколько лет. Они автоматизируют работу по проверке и изменят будущее верификации.

Мнение редакции может не совпадать с мнением автора. Ваши статьи присылайте нам на 42@cossa.ru. А наши требования к ним — вот тут.